1.分分鐘扒一個網頁下來

怎樣扒網頁呢?其實就是根據URL來獲取它的網頁信息,雖然我們在瀏覽器中看到的是一幅幅優美的畫面,但是其實是由瀏覽器解釋才呈現出來的,實質它 是一段HTML代碼,加 JS、CSS,如果把網頁比作一個人,那么HTML便是他的骨架,JS便是他的肌肉,CSS便是它的衣服。所以最重要的部分是存在于HTML中的,下面我 們就寫個例子來扒一個網頁下來。

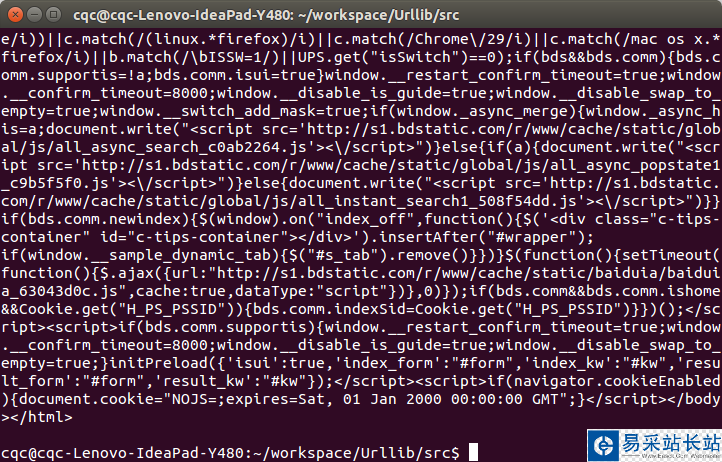

import urllib2 response = urllib2.urlopen("http://www.baidu.com")print response.read()是的你沒看錯,真正的程序就兩行,把它保存成 demo.py,進入該文件的目錄,執行如下命令查看運行結果,感受一下。

python demo.py

看,這個網頁的源碼已經被我們扒下來了,是不是很酸爽?

2.分析扒網頁的方法

那么我們來分析這兩行代碼,第一行

response = urllib2.urlopen("http://www.baidu.com")首先我們調用的是urllib2庫里面的urlopen方法,傳入一個URL,這個網址是百度首頁,協議是HTTP協議,當然你也可以把HTTP換做FTP,FILE,HTTPS 等等,只是代表了一種訪問控制協議,urlopen一般接受三個參數,它的參數如下:

urlopen(url, data, timeout)

第一個參數url即為URL,第二個參數data是訪問URL時要傳送的數據,第三個timeout是設置超時時間。

第二三個參數是可以不傳送的,data默認為空None,timeout默認為 socket._GLOBAL_DEFAULT_TIMEOUT

第一個參數URL是必須要傳送的,在這個例子里面我們傳送了百度的URL,執行urlopen方法之后,返回一個response對象,返回信息便保存在這里面。

print response.read()

response對象有一個read方法,可以返回獲取到的網頁內容。

如果不加read直接打印會是什么?答案如下:

<addinfourl at 139728495260376 whose fp = <socket._fileobject object at 0x7f1513fb3ad0>>

直接打印出了該對象的描述,所以記得一定要加read方法,否則它不出來內容可就不怪我咯!

3.構造Requset

其實上面的urlopen參數可以傳入一個request請求,它其實就是一個Request類的實例,構造時需要傳入Url,Data等等的內容。比如上面的兩行代碼,我們可以這么改寫

import urllib2 request = urllib2.Request("http://www.baidu.com")response = urllib2.urlopen(request)print response.read()運行結果是完全一樣的,只不過中間多了一個request對象,推薦大家這么寫,因為在構建請求時還需要加入好多內容,通過構建一個request,服務器響應請求得到應答,這樣顯得邏輯上清晰明確。

新聞熱點

疑難解答